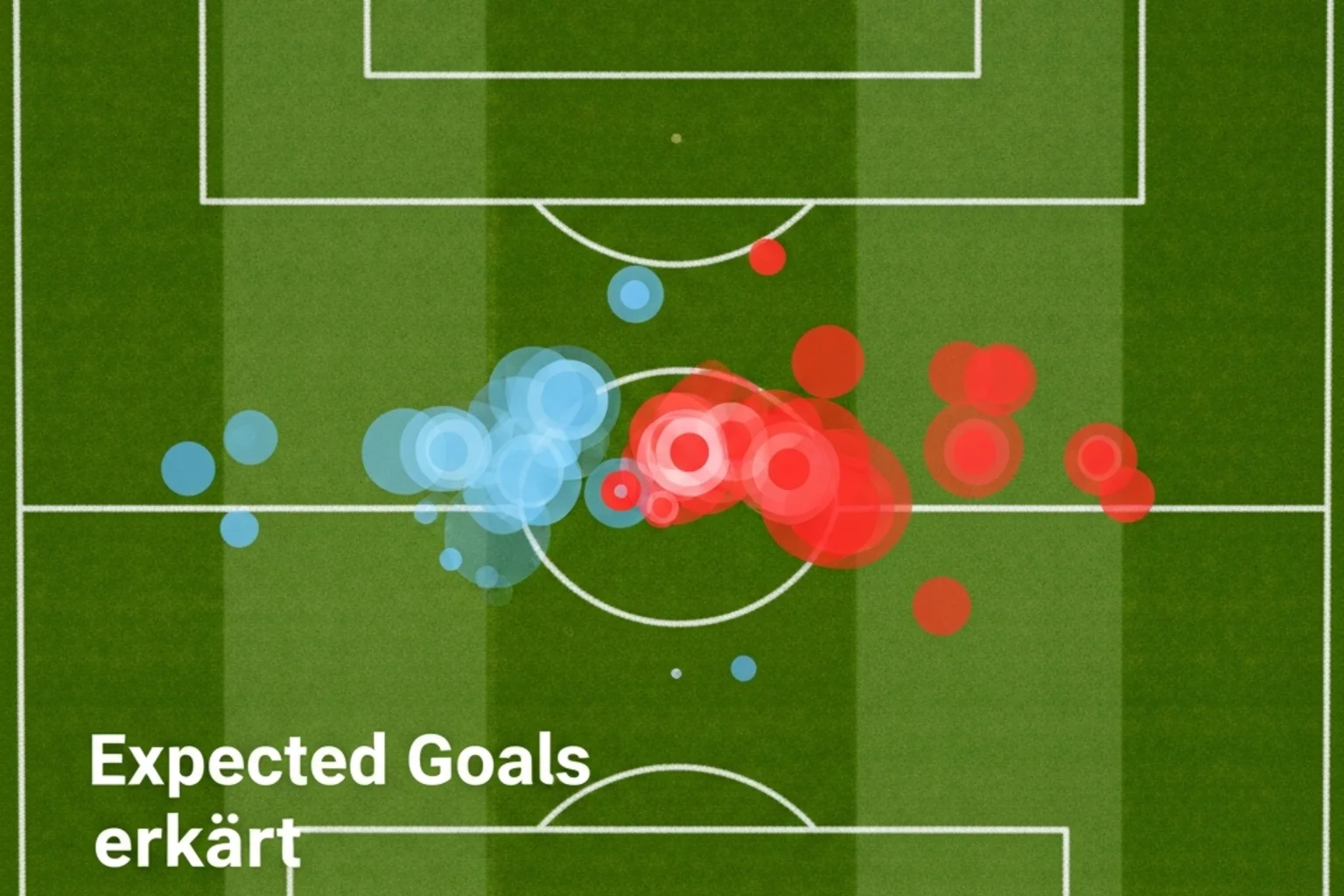

Nicht jeder Schuss ist gleich. Das ist der Kern einer Idee, die den Fußball in den letzten zehn Jahren stärker verändert hat als jede Taktiktafel: Expected Goals, kurz xG. Die Metrik weist jedem Torschuss eine Wahrscheinlichkeit zu, mit der er unter durchschnittlichen Bedingungen zum Tor wird. Ein Kopfball aus elf Metern nach einer Flanke ist nicht dasselbe wie ein Flachschuss aus fünf Metern nach einem Dribbling — und xG macht diesen Unterschied messbar.

Wer heute eine xG-Erklärung im Fußball sucht, findet sie überall: in den Matchday-Grafiken der Bundesliga, in den Analysetools von FBref und Understat, in den Scouting-Abteilungen der Proficlubs. Die Zahl, die einst ein Nischenprodukt akademischer Forschung war, ist zum Standardvokabular der Sportberichterstattung geworden. Fernsehsender blenden xG-Werte nach Spielen ein, Podcast-Moderatoren diskutieren Overperformance und Underperformance, und auf Social Media wird erbittert darüber gestritten, ob ein Sieg „verdient“ war oder nicht.

Doch die Verbreitung von xG hat auch zu einer seltsamen Situation geführt: Viele kennen die Zahl, aber wenige wissen, wie sie entsteht. Was genau berechnet ein xG-Modell? Welche Variablen fließen ein? Wie unterscheiden sich die Modelle von StatsBomb, Opta und der akademischen Forschung? Und vor allem: Wie genau ist xG tatsächlich, wenn man es an realen Ergebnissen misst?

Dieser Artikel beantwortet diese Fragen — nicht als vereinfachte Einführung, sondern als fundierter Überblick, der die Methodik hinter der Metrik offenlegt. Von der Berechnung über den Modellvergleich bis zur empirischen Genauigkeit, gestützt auf aktuelle Studien aus der Bundesliga.

Die Berechnung dieser Werte erfolgt heute meist durch hochkomplexe KI-Systeme im Fußball, die tausende Datenpunkte gleichzeitig verarbeiten.

Mathematische Grundlagen: Die Variablen der xG-Berechnung

Expected Goals — zu Deutsch: erwartete Tore — ist ein statistisches Maß, das die Qualität eines Torschusses beziffert. Der xG-Wert eines einzelnen Schusses liegt zwischen 0 und 1 und gibt die Wahrscheinlichkeit an, dass dieser Schuss unter historisch vergleichbaren Bedingungen zum Tor führt. Ein xG von 0,75 bedeutet: Von 100 ähnlichen Schüssen werden im Durchschnitt 75 verwandelt. Ein xG von 0,03 bedeutet: Nur drei von hundert.

Die Berechnung basiert auf einem maschinellen Lernmodell, das aus Tausenden historischer Torschüsse trainiert wird. Das Modell lernt, welche Eigenschaften eines Schusses mit einer höheren oder niedrigeren Torwahrscheinlichkeit korrelieren. Die wichtigsten Variablen, die in nahezu jedem xG-Modell enthalten sind, lassen sich in drei Kategorien einteilen.

Die erste Kategorie ist die Schussposition. Entfernung zum Tor und Winkel zum Tor sind die stärksten Prädiktoren. Ein Schuss aus fünf Metern zentral vor dem Tor hat einen grundlegend anderen xG-Wert als ein Schuss aus 25 Metern am Strafraumrand. Die Geometrie des Fußballfelds erklärt bereits einen erheblichen Teil der Torvarianz — je weiter weg und je spitzer der Winkel, desto unwahrscheinlicher der Treffer.

Die zweite Kategorie betrifft die Art des Schusses. Ein Kopfball hat generell einen niedrigeren xG-Wert als ein Schuss mit dem Fuß aus vergleichbarer Position, weil die Kontrolle über Richtung und Kraft geringer ist. Volley-Schüsse, Direktabnahmen und Schüsse nach Dribblings werden ebenfalls unterschiedlich bewertet. Einige Modelle unterscheiden sogar zwischen starkem und schwachem Fuß des Schützen.

Die dritte Kategorie — und hier trennen sich einfache von komplexen Modellen — ist der Spielkontext. Wie viele Verteidiger stehen zwischen Ball und Tor? Befindet sich der Torhüter auf der Linie oder ist er herausgelaufen? Kam der Ball als Flanke, als Steilpass oder nach einem Eckball? Diese Kontextvariablen machen den Unterschied zwischen einem groben Schätzwert und einem präzisen Modell.

Eine Studie aus dem Jahr 2025, veröffentlicht in Frontiers in Sports and Active Living, demonstriert, wie weit ein vergleichsweise sparsames Modell kommen kann. Die Forscher nutzten einen Bayesian-Ansatz mit nur sieben Variablen — darunter Schusstyp, Position und Positionen der Verteidiger — und erreichten eine AUC von 0,781. Die AUC, kurz für Area Under the Curve, ist ein Standardmaß für die Unterscheidungsfähigkeit eines Klassifikationsmodells: Ein Wert von 0,5 entspricht dem Zufall, ein Wert von 1,0 der perfekten Vorhersage. Ein Wert von 0,781 bedeutet: Das Modell kann in fast 80 Prozent der Fälle korrekt einschätzen, ob ein Schuss eher zum Tor führt oder nicht.

Dass sieben Variablen bereits für eine solche Trennschärfe ausreichen, ist bemerkenswert. Es zeigt, dass die Grundlogik von xG robust ist: Position und Schusstyp erklären den Großteil der Varianz. Die restlichen 20 Prozent verteilen sich auf Faktoren, die schwerer zu messen sind — individuelle Qualität des Schützen, Druck der Spielsituation, psychologische Komponenten. Kein Modell wird diese Lücke vollständig schließen, aber der Abstand zwischen dem, was xG erfasst, und dem, was es nicht erfasst, ist kleiner, als viele Kritiker annehmen.

Für die praktische Anwendung addiert man die xG-Werte aller Schüsse einer Mannschaft zu einem Gesamtwert pro Spiel. Wenn eine Mannschaft Schüsse mit einem kumulierten xG von 2,3 abgibt, aber nur ein Tor erzielt, hat sie ihre Chancen unterdurchschnittlich verwertet. Umgekehrt: Erzielt eine Mannschaft drei Tore bei einem xG von 1,1, hat sie entweder herausragende Abschlussstärke oder schlicht Glück gehabt. Die Frage, was von beidem zutrifft, ist der Kern dessen, was xG in der Analyse leisten soll.

xG-Modelle: StatsBomb, Opta und akademische Ansätze

xG ist keine einheitliche Metrik. Es gibt keinen universellen Standard, keine zentrale Behörde, die festlegt, wie Expected Goals berechnet werden. Stattdessen existieren parallel mehrere Modelle — kommerzielle und akademische —, die sich in Methodik, Datengrundlage und Ergebnissen teilweise erheblich unterscheiden. Wer xG-Werte vergleicht, muss wissen, woher sie stammen.

Die beiden einflussreichsten kommerziellen Anbieter sind Opta (Teil von Stats Perform) und StatsBomb. Opta liefert die xG-Daten, die in den meisten Medienberichten und auf Plattformen wie WhoScored zu finden sind. Das Modell basiert auf einer umfangreichen Datenbank historischer Schüsse und berücksichtigt Position, Schusstyp und eine Reihe von Kontextfaktoren. Opta veröffentlicht keine vollständige technische Dokumentation, was die externe Überprüfung erschwert — ein Punkt, der in der Fachgemeinschaft regelmäßig kritisiert wird.

StatsBomb verfolgt einen offeneren Ansatz. Das Unternehmen hat Teile seiner Methodik publiziert und stellt über die Plattform FBref kostenlose xG-Daten zur Verfügung, die auf dem eigenen Modell basieren. Ein wesentlicher Unterschied zu Opta ist die Berücksichtigung von Körperpositionen und Verteidigerbewegungen, die durch ereignisbasierte Daten und zum Teil durch Freeze-Frame-Analysen erfasst werden. StatsBomb gibt für sein Modell eine AUC von 0,801 an — ein Wert, der über dem des oben beschriebenen Bayesian-Modells liegt und zu den besten veröffentlichten Ergebnissen in der xG-Forschung gehört.

Die Differenz zwischen 0,781 und 0,801 mag gering wirken, aber in der Praxis ist sie relevant. Eine höhere AUC bedeutet, dass das Modell in strittigen Fällen — also bei Schüssen, die weder offensichtliche Tore noch offensichtliche Fehlschüsse sind — besser differenziert. Über eine Saison mit mehreren tausend Schüssen summieren sich diese Unterschiede zu spürbaren Abweichungen in den xG-Tabellen.

Neben den kommerziellen Modellen gibt es eine wachsende Zahl akademischer Ansätze. Die Forschung konzentriert sich vor allem auf zwei methodische Strömungen: Bayesian-Modelle und Ensemble-Methoden wie Random Forest oder Gradient Boosting. Bayesian-Modelle haben den Vorteil, dass sie Unsicherheiten explizit quantifizieren — sie sagen nicht nur „dieser Schuss hat einen xG von 0,35″, sondern geben auch an, wie sicher das Modell in dieser Schätzung ist. Das ist für die Interpretation wertvoll, weil es zeigt, wo das Modell an seine Grenzen stößt.

Random-Forest-Modelle und verwandte Ansätze sind in der Regel etwas genauer, dafür aber weniger transparent. Sie nutzen Hunderte von Entscheidungsbäumen, deren Zusammenspiel schwer zu interpretieren ist — ein klassischer Trade-off zwischen Vorhersagekraft und Erklärbarkeit. In der akademischen Literatur werden beide Ansätze häufig gegenübergestellt, wobei die Unterschiede in der Prognosegenauigkeit selten mehr als zwei bis drei Prozentpunkte betragen.

Was bedeutet das für den Nutzer? Wer xG-Werte auf verschiedenen Plattformen vergleicht, wird Abweichungen feststellen. Ein Spiel, das laut Opta ein knappes 1,5 zu 1,2 war, kann bei StatsBomb als 1,8 zu 0,9 erscheinen. Diese Unterschiede sind kein Fehler, sondern die logische Konsequenz unterschiedlicher Modellarchitekturen und Datengrundlagen. Die richtige Reaktion ist nicht, ein Modell als „das beste“ zu deklarieren, sondern zu verstehen, dass xG ein Näherungswert ist — und dass die Konsistenz innerhalb eines Modells wichtiger ist als die absolute Zahl.

Wie genau ist xG? Studien aus der Bundesliga

Die entscheidende Frage bei jeder statistischen Metrik lautet: Funktioniert sie? Für xG gibt es mittlerweile eine belastbare empirische Grundlage, die diese Frage differenziert beantwortet — und die Antwort ist weder ein klares Ja noch ein klares Nein.

Die bislang umfangreichste Studie zur Vorhersagekraft von xG im deutschen Fußball stammt von Forcher und Kollegen, veröffentlicht 2025 in Frontiers in Sports and Active Living. Die Forscher analysierten 918 Bundesliga-Spiele über mehrere Saisons und verglichen, wie gut verschiedene Metriken den tatsächlichen Spielausgang vorhersagen. Das Ergebnis: xG post-match — also die xG-Summe nach Abschluss aller Schüsse — prognostiziert den Spielausgang in 65,6 Prozent der Fälle korrekt, gemessen am Ranked Probability Score (RPS = 0,148).

65,6 Prozent klingt zunächst unspektakulär. Aber der Wert gewinnt an Bedeutung, wenn man ihn in Kontext setzt. Fußball ist ein Spiel mit niedriger Torquote und hoher Ergebnisvarianz — Zufallsereignisse wie Eigentore, Elfmeterentscheidungen oder Lattentreffer beeinflussen das Ergebnis stärker als in Sportarten mit vielen Punkten pro Spiel. Zum Vergleich: Im Basketball, wo pro Spiel über 200 Punkte fallen, liegt die Vorhersagegenauigkeit statistischer Modelle deutlich höher — schlicht weil der Zufall dort weniger Gewicht hat. Eine Metrik, die unter den Bedingungen des Fußballs zwei von drei Spielen korrekt einordnet, leistet erheblich mehr, als die nackte Zahl vermuten lässt.

Die Studie liefert noch einen zweiten, weniger beachteten Befund: den Vergleich zwischen xG und Expected Points Value (EPV). EPV ist ein alternatives Modell, das nicht den einzelnen Schuss, sondern den Wert jeder Ballbesitzaktion beziffert — vom Einwurf über den Pass bis zum Abschluss. Im post-match-Szenario schneidet EPV mit 59,6 Prozent Genauigkeit schlechter ab als xG. Im pre-match-Szenario dreht sich das Bild: EPV erreicht 58,3 Prozent, xG nur 55,6 Prozent.

Dieser Unterschied ist aufschlussreich. Er zeigt, dass xG seine Stärke vor allem als retrospektives Werkzeug entfaltet — als Maß dafür, was in einem Spiel passiert ist und wie die Chancenverteilung aussah. Für die Vorhersage zukünftiger Spiele, bei denen noch keine Schussdaten vorliegen, bieten kontextreichere Modelle wie EPV möglicherweise mehr Substanz. Das ist kein Argument gegen xG, sondern eine Präzisierung seiner optimalen Anwendung.

Ein weiterer Aspekt der Genauigkeitsdiskussion betrifft die Stichprobengröße. xG-Werte für ein einzelnes Spiel unterliegen einer erheblichen Schwankungsbreite. Ein Team mit einem xG von 2,0 kann in einem Spiel null Tore erzielen und im nächsten vier — beides wäre statistisch nicht ungewöhnlich. Erst über eine größere Anzahl von Spielen — die Forschung legt nahe, dass mindestens zehn bis fünfzehn Spiele nötig sind — nähert sich die tatsächliche Torausbeute dem xG-Erwartungswert an. Wer nach einem einzelnen Spieltag xG-Werte interpretiert, betreibt keine Analyse, sondern Kaffeesatzlesen.

Die Genauigkeit von xG hat sich über die letzten Jahre verbessert, weil die Datengrundlage gewachsen ist und die Modelle verfeinert wurden. Doch es gibt eine natürliche Obergrenze: Solange Fußball von menschlichen Akteuren gespielt wird, deren individuelle Fähigkeiten, physische Tagesform und mentale Verfassung nicht vollständig modellierbar sind, wird kein xG-Modell die 70-Prozent-Marke der post-match-Genauigkeit deutlich überschreiten. Das ist keine Schwäche, sondern eine ehrliche Aussage darüber, was statistische Modelle in einem chaotischen System leisten können.

xG in der Praxis: Für Fans, Trainer und Analysten

Die Theorie ist das eine, die Anwendung das andere. Die Metrik hat in den letzten Jahren eine bemerkenswerte Reise gemacht: von einem akademischen Konzept über ein Scouting-Werkzeug bis hin zu einem festen Bestandteil der Fußballberichterstattung. Je nach Perspektive — Fan, Trainer oder professioneller Analyst — ergeben sich unterschiedliche Anwendungen und unterschiedliche Fallstricke.

Für Fans ist xG vor allem ein Werkzeug der Kontextualisierung. Nach einem 1:0-Sieg fragt xG: War das ein verdienter Sieg oder ein glücklicher? Wenn die xG-Bilanz 0,4 zu 2,1 lautet, spricht wenig für die Leistung des Siegers — er hat seine einzige Halbchance verwertet, während der Verlierer mehrere hochwertige Gelegenheiten ausließ. Umgekehrt: Ein 3:0 bei einem xG von 3,2 zu 0,5 bestätigt die optische Überlegenheit mit Daten. Plattformen wie FBref, Understat und Fotmob stellen diese Daten nach jedem Spieltag kostenlos zur Verfügung und machen damit eine Analyseebene zugänglich, die vor einem Jahrzehnt nur Proficlubs offenstand.

Der häufigste Anwendungsfall in der Fansphäre ist die Diskussion um Overperformance und Underperformance. Wenn ein Stürmer nach der Hinrunde zwölf Tore bei einem xG von sieben hat, performt er deutlich über dem Erwartungswert. Die Frage ist dann: Ist er außergewöhnlich gut im Abschluss, oder profitiert er von einer Glückssträhne, die sich in der Rückrunde korrigieren wird? Historische Daten zeigen, dass extreme Overperformance selten über eine ganze Saison aufrechterhalten wird — ein Befund, der für die Bewertung von Spielern und Mannschaften erhebliche Konsequenzen hat.

Für Trainer und Taktik-Analysten liegt der Wert von xG weniger in der Bewertung einzelner Spieler als in der Analyse von Spielsituationen. Wo entstehen die hochwertigsten Chancen? Welche Angriffsrouten führen zu Schüssen mit hohem xG? Welche Defensivfehler ermöglichen dem Gegner Abschlüsse aus gefährlichen Positionen? Die Antworten auf diese Fragen fließen direkt in die Trainingsarbeit ein — etwa in die Gestaltung von Standardsituationen, die Positionierung im letzten Drittel oder die Analyse gegnerischer Schwachstellen.

Im professionellen Scouting hat xG eine noch spezifischere Rolle. Es dient dort als Filter: Spieler, deren tatsächliche Torquote dauerhaft über ihrem xG liegt, sind entweder außergewöhnliche Abschlussspieler oder spielen in einem System, das ihnen überdurchschnittlich gute Chancen verschafft. Beides ist wertvoll, aber die Ursache zu identifizieren, erfordert eine Analyse, die über den reinen xG-Wert hinausgeht. Jan Wendt, CEO der KI-Scouting-Plattform Plaier, beschreibt diesen Ansatz: „Wir können immer sagen, was macht ein Spieler am Ball, welche Aktionen nimmt er sich in welchem Raum, unter wie viel Druck steht er bei welcher Aktion in welcher Spielphase? Wir sagen bei Transfers voraus, wer die Mannschaft besser macht. Da haben wir eine neunzigprozentige Trefferquote.“ — Jan Wendt, CEO, Plaier

Wer xG in der Praxis nutzen will, sollte drei Grundregeln beachten. Erstens: Nie ein einzelnes Spiel überbewerten. xG entfaltet seine Aussagekraft über größere Stichproben. Zweitens: Immer das Modell kennen. Die xG-Werte von Opta, StatsBomb und Understat unterscheiden sich — Vergleiche über Modellgrenzen hinweg sind irreführend. Drittens: xG als einen Baustein behandeln, nicht als endgültiges Urteil. Die Metrik misst die Qualität der Torchancen, nicht die Qualität des Spiels. Ein Team kann taktisch brillant agieren und trotzdem ein niedriges xG haben, wenn es auf Konter setzt und wenige, aber effiziente Abschlüsse anstrebt.

Grenzen von xG: Was die Metrik nicht erfasst

Jede Metrik hat blinde Flecken, und xG bildet keine Ausnahme. Die Grenzen der Metrik zu kennen ist mindestens so wichtig wie zu verstehen, was sie misst — denn die häufigsten Fehlinterpretationen entstehen nicht durch falsche Berechnung, sondern durch falsche Erwartungen.

Die offensichtlichste Einschränkung betrifft den Torhüter. Standard-xG-Modelle berücksichtigen nicht, wer im Tor steht. Ein Schuss mit einem xG von 0,4 hat dieselbe Bewertung, unabhängig davon, ob er auf einen Weltklasse-Keeper oder einen Ersatztorwart geht. Das ist eine bewusste Designentscheidung, die den Schuss isoliert bewerten soll — aber in der Praxis führt sie dazu, dass Teams, die gegen schwache Torhüter spielen, systematisch weniger Tore erzielen als ihr xG vermuten ließe, und umgekehrt. Die Antwort der Statistikbranche auf dieses Problem heißt Post-Shot xG (PSxG), das die Schussplatzierung nach dem Abschluss einbezieht und damit eine genauere Bewertung der Torhüterleistung ermöglicht.

Eine zweite Grenze liegt im Spielkontext. xG erfasst die physische Situation zum Zeitpunkt des Schusses — Position, Winkel, Verteidigerstellungen. Was es nicht erfasst, ist der psychologische und taktische Kontext: Spielt das Team in Unterzahl? Ist es die 89. Minute bei einem Rückstand? Handelt es sich um ein Relegationsspiel oder ein bedeutungsloses Saisonende? Diese Faktoren beeinflussen das Verhalten von Spielern — Risikobereitschaft, Konzentration, Entscheidungsgeschwindigkeit —, aber sie fließen in kein gängiges xG-Modell ein.

Drittens ignoriert xG per Definition alles, was nicht zum Schuss führt. Ein Team kann einen Gegner neunzig Minuten lang dominieren, den Ball in dessen Hälfte halten und dennoch ein xG von null haben, wenn kein einziger Abschluss zustande kommt. Das ist kein Fehler des Modells, sondern seine Designprämisse: xG misst Schussqualität, nicht Spielqualität. Wer die Gesamtleistung eines Teams bewerten will, braucht zusätzliche Metriken — PPDA für den Pressingdruck, progressive Pässe für die Vorwärtsbewegung, Expected Threat für den Wert jeder Ballbesitzaktion.

Schließlich gibt es das Problem der individuellen Spielerqualität. xG geht von einem durchschnittlichen Schützen aus. Spieler wie Lionel Messi oder Robert Lewandowski, die über ihre gesamte Karriere hinweg konstant mehr Tore erzielen als ihr xG vorhersagt, widerlegen diese Annahme — nicht weil das Modell falsch rechnet, sondern weil sie systematisch über dem Durchschnitt liegen. Für diese Ausnahme-Spieler ist xG kein geeignetes Bewertungsinstrument ihrer Abschlussqualität, wohl aber ein nützliches Maß für die Qualität ihrer Chancen.

Die Kritik an xG ist berechtigt, wenn sie auf diese Grenzen hinweist. Sie ist unberechtigt, wenn sie der Metrik vorwirft, etwas nicht zu leisten, was sie nie leisten sollte. xG ersetzt weder das Auge des Trainers noch die Intuition des Scouts. Es ergänzt beides um eine Dimension, die ohne Daten nicht zugänglich wäre.

Fazit: xG verstehen — Spiele anders sehen

Expected Goals hat den Fußball nicht revolutioniert — aber es hat die Art verändert, wie wir über ihn sprechen. Die Metrik liefert eine gemeinsame Sprache für Fans, Analysten und Profis, die über das bloße Ergebnis hinausgeht und fragt: Was hätte passieren sollen, gegeben die Chancen, die sich ergeben haben?

Die Stärke von xG liegt in seiner Einfachheit. Ein einzelner Wert pro Schuss, aggregiert über ein Spiel oder eine Saison, kann als grober Kompass dienen — nicht als GPS-Navigation, aber als verlässliche Orientierung. Die Studien aus der Bundesliga zeigen, dass dieser Kompass in rund zwei Dritteln der Fälle in die richtige Richtung zeigt. Das ist mehr als Zufall, weniger als Gewissheit, und genau das Maß an Präzision, das man von einer statistischen Metrik in einem Sport mit niedriger Torquote und hoher Ergebnisvarianz realistisch erwarten sollte.

Die Schwäche von xG ist die Kehrseite derselben Einfachheit. Die Metrik weiß nichts über Torhüter, nichts über psychologischen Druck und nichts über das Spiel jenseits des Abschlusses. Wer xG als alleiniges Analysetool verwendet, sieht den Fußball durch ein Schlüsselloch. Wer es als eines von mehreren Werkzeugen einsetzt, gewinnt eine Perspektive, die mit dem bloßen Auge nicht erreichbar wäre.

Nicht jeder Schuss ist gleich. Das zu wissen verändert nicht das Spiel, aber es verändert das Verständnis davon — und manchmal ist das genug.

Quellen

- Forcher et al. — Frontiers in Sports and Active Living (2025): „xG and EPV for Match Outcome Prediction“ — frontiersin.org

- Iapteff et al. — PMC/Frontiers (2025): „Bayesian xG Model“ — pmc.ncbi.nlm.nih.gov

- Opta Football Stats Definitions — theanalyst.com

Erfahren Sie mehr über moderne Metriken bei Ihrem Experten für Fußball-Metriken.